In the dawn of the 21st Century we watch and analyze new products, ventures and ideas for Artificial Intelligence for the benefits of Human Beings. Robots and Cyborgs will live along the Humans and Animals, in a peaceful coexistence.

Monday, November 26, 2012

Thursday, November 15, 2012

Saturday, November 10, 2012

Friday, October 19, 2012

Saturday, October 13, 2012

Tuesday, October 2, 2012

Wednesday, September 19, 2012

Monday, September 17, 2012

Wednesday, September 12, 2012

Saturday, September 8, 2012

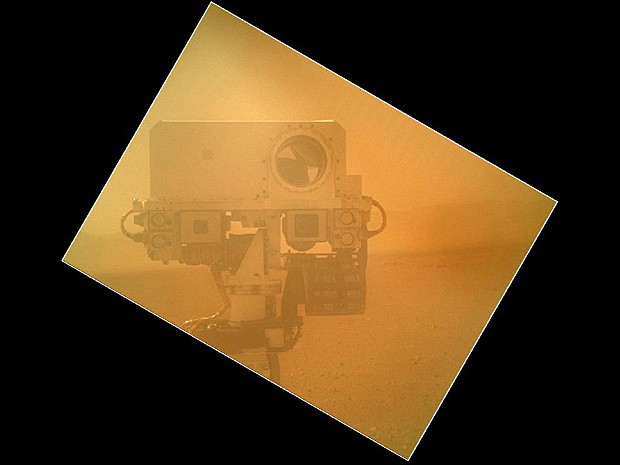

Robô Curiosity usa câmera no braço para tirar auto-retrato em Marte

Robô Curiosity usa câmera no braço para tirar auto-retrato

em Marte

Veículo testa lente de câmera antes de usá-la com mais

frequência.

Jipe Opportunity também fez imagens da superfície do planeta vermelho.

Jipe Opportunity também fez imagens da superfície do planeta vermelho.

O robô Curiosity, que está em Marte há um mês, usou uma

câmera localizada em um de seus braços para tirar um autorretrato. A foto foi

feita na sexta-feira (7) e divulgada neste sábado (8) pela agência espacial

americana (Nasa).

O que a princípio parece vaidade é, de fato, um teste para

verificar se a câmera Mahli estava funcionando corretamente. A imagem foi

captada intencionalmente com a tampa sobre a lente, para observar se ela estava

livre de detritos que eventualmente pudessem danificar o equipamento.

A imagem também mostra as câmeras Mastcams, situada no

mastro do veículo, e Chemcam. O ângulo do quadro reflete a posição da Mahli.

Esta semana, outros instrumentos e ferramentas do Curiosity

foram avaliados, por meio de imagens registradas pelas Mastcams e Navcams. Na

foto abaixo, está o equipamento Chimra, que está sendo analisado e, assim que

for liberado, deve agitar e peneirar amostras do solo para estudar a composição

orgânica de Marte.

Wednesday, September 5, 2012

Monday, September 3, 2012

HUBO - Korean Walking Humanoid Robot

HUBO (휴보

KHR-3) is a walking humanoid robot, head mounted on a life-size walking bipedal frame,

developed by the Korea

Advanced Institute of Science and Technology(KAIST) and released on January

6, 2005. Hubo is short form for "humanoid robot."

Hubo has voice recognition and synthesis faculties, as well

as sophisticated vision in which its two eyes move independently of one another.

Korea's history in robotics engineering is relatively short.

KAIST only began research in 2000, led by professor Oh Jun-ho. The first prototype,

KHR-0, consisting of two legs without an upper body was built by 2001. KHR-1 was

developed without a head or hands released in 2003, followed by a complete

humanoid KHR-2 in

2004.[1]

On January 25, 2005, Gizmag reported on KAIST's unveiling of

the KHR-3 HUBO.[2]

The KHR-3's physical specifications, such as height, weight,

and the number of DOFs (degrees of freedom), were similar to Honda's ASIMO,

which served as the benchmark for the project. In terms of AI and movements,

HUBO fell short of the "next-gen ASIMO," which was unveiled three

months later. While HUBO could only walk at 1.25 km/h, the ASIMO could

walk at 2.5 km/h and also run at 3 km/h . The ASIMO was also capable of

walking up and down stairs, which was a temporary shortcoming for HUBO needing

further development. The unnerved KAIST researchers noted, however, that HUBO

could play kai-bai-bo (the Korean version of rock-paper-scissors), which was impossible for

ASIMO since its fingers could not move independently of each other.[1]

On November

of '05, KAIST, Korea and Dallas , Texas based

Hanson Robotics, Inc (HRI) released the world's first android head mounted on a

life-size walking bi-pedal frame at the APEC Summit in Seoul , Korea

The humanoid prototype was officially dubbed "Albert Einstein Hubo".

Jaemi HUBO was developed from 2008 to 2009. The complete

humanoid robot was given a slimmer design with an aluminum endoskeleton and a

polycarbonate frame, resulting in a slightly taller height but a 20% lighter

weight than its predecessors. Its movements were more realistic since the arms

made quicker and more natural motions, and the legs could stretch to imitate

human walking, which also consumes less energy than the traditional humanoid

walking based on the Zero

Moment Point trajectory. Its walking speed was improved to

1.4 km/h, and it also acquired the ability to run at 3.6 km/h (which

is still much slower than the new ASIMO's 6 km/h by

comparison).[1]

|

|

KHR-0

(2001) |

KHR-1

(2002) |

KHR-2

(2004) |

HUBO (KHR-3)

(2005) |

Albert HUBO

(2005) |

HUBO 2 (KHR-4)

(2008) |

|

Weight

|

|

|

|

|

|

|

|

Height

|

|

|

|

|

|

|

|

Walking speed

|

-

|

1.0 km/h

|

1.2 km/h

|

1.25 km/h

|

1.25 km/h

|

1.5 km/h

|

|

Continuous operating

time

|

-

|

-

|

-

|

60 minutes

|

60 minutes

|

120 minutes

|

|

12

|

21

|

41

|

41

|

66

|

40

|

Wednesday, August 29, 2012

A Robot on Mars: Curiosity Broadcasts Images to Times Square

The Toshiba Vision screen in New York City's Times Square is

giving visitors and New York City locals the opportunity to see photos from

NASA’s Curiosity rover on Mars.

The Toshiba Vision screen will broadcast photos taken by the Curiosity rover from now through October 15, with new photos being added every two weeks. The rover is just beginning its two years of unprecedented scientific detective work after a successful landing on Aug. 5, 2012.

"NASA is committed to engaging the American public in our missions, said David Weaver, Associate Administrator for NASA’s Office of Communications. “Curiosity has sparked people’s imagination and excitement, and we are thrilled to have this opportunity to continue showing the many people who walk through Times Square every day the amazing work the rover is doing on Mars."

Prominently positioned below the world-famous New Year's Eve ball in Times Square, the Toshiba Vision dual LED screens hosted a viewing party for thousands of people during Curiosity’s landing. The broadcast from JPL Mission Control and the first pictures from Mars were viewed by locals and visitors who came to Times Square to participate in the biggest NASA planetaryscience mission ever attempted. People watched as Curiosity landed on Mars from many different places around the country. Watch video.

Curiosity will investigate whether an area with a wet history inside Mars' Gale Crater ever has offered an environment favorable for microbial life.

The mission is managed by JPL for NASA's Science Mission Directorate in Washington. Curiosity was designed, developed and assembled at JPL. For more about NASA's Curiosity mission, visit: http://www.nasa.gov/mars andhttp://marsprogram.jpl.nasa.gov/msl.

The Toshiba Vision screen will broadcast photos taken by the Curiosity rover from now through October 15, with new photos being added every two weeks. The rover is just beginning its two years of unprecedented scientific detective work after a successful landing on Aug. 5, 2012.

"NASA is committed to engaging the American public in our missions, said David Weaver, Associate Administrator for NASA’s Office of Communications. “Curiosity has sparked people’s imagination and excitement, and we are thrilled to have this opportunity to continue showing the many people who walk through Times Square every day the amazing work the rover is doing on Mars."

Prominently positioned below the world-famous New Year's Eve ball in Times Square, the Toshiba Vision dual LED screens hosted a viewing party for thousands of people during Curiosity’s landing. The broadcast from JPL Mission Control and the first pictures from Mars were viewed by locals and visitors who came to Times Square to participate in the biggest NASA planetaryscience mission ever attempted. People watched as Curiosity landed on Mars from many different places around the country. Watch video.

Curiosity will investigate whether an area with a wet history inside Mars' Gale Crater ever has offered an environment favorable for microbial life.

The mission is managed by JPL for NASA's Science Mission Directorate in Washington. Curiosity was designed, developed and assembled at JPL. For more about NASA's Curiosity mission, visit: http://www.nasa.gov/mars andhttp://marsprogram.jpl.nasa.gov/msl.

Friday, August 17, 2012

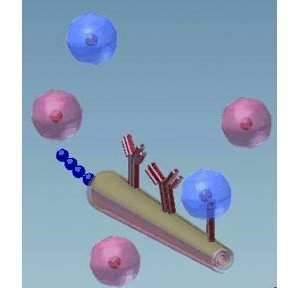

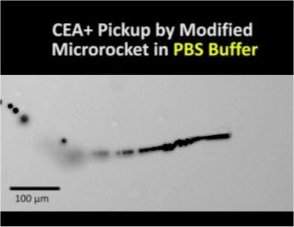

Microfoguete navega pelo sangue e captura células doentes

Viagem fantástica espacial

Um submarino microscópico capaz de navegar no interior do corpo humano é uma

situação que a ficção científica já se incumbiu de tornarfamiliar para

a maior parte das pessoas.

Ainda que tal possibilidade esteja longe de se realizar,

pesquisadores resolveram avançar um pouco mais no conceito e adotar uma

alternativa mais afeita à "era espacial".

Os cientistas construíram um microfoguete capaz de se mover

em alta velocidade no interior de fluidos biológicos, como o sangue.

Mais do que isso: o corpo do microfoguete pode ser ajustado

para capturar células de diferentes tipos de câncer que estejam presentes naamostra de sangue.

Microfoguete rastreador de células

O microfoguete é revestido com anticorpos que aderem a

proteínas presentes na superfície das células de câncer.

Esses anticorpos são selecionados de acordo com a proteína que devem

alvejar, o que torna o conceito uma ferramenta altamente seletiva, capaz de

procurar por doenças específicas.

Para biocompatibilidade, evitando-se qualquer tipo de

contaminação, toda a parte externa do microfoguete é feita de ouro.

O combustível usado é o peróxido de hidrogênio. Um

revestimento de platina no interior do microfoguete serve como catalisador para

quebrar as moléculas do peróxido de hidrogênio em água e oxigênio - o

microfoguete é empurrado para a frente quando o oxigênio escapa pelo seu bocal.

Entre o revestimento interno de

platina e o corpo externo de ouro, há uma camada de ferro, que permite que os

pesquisadores dirijam o microfoguete usando um campo magnético externo.

Microrrobô

O microfoguete foi idealizado por Samuel Sanchez e seus

colegas do Instituto Leibniz, na Alemanha.

A equipe de Joseph Wang, da Universidade da

Califórnia, nos Estados Unidos, testou-o como caçador de células cancerosas,

dando-lhe uma funcionalidade que o transforma numa espécie de microrrobô.

O pequeno foguete foi testado em solução salina e no soro de

sangue humano, equipado para anticorpos para detectar células de três tipos de

câncer - gástrico, colorretal e pancreático.

O microrrobô apresentou uma eficiência de 70%, mostrando-se

capaz de continuar a se mover, embora mais lentamente, mesmo depois de capturar

suas células-alvo.

Por enquanto, o microrrobô se mostra promissor para a

análise de amostras de sangue ou outros fluidos humanos - como seu combustível,

o peróxido de hidrogênio, deve ser adicionado ao fluido onde ele deve navegar,

não seria possível seu uso diretamente no interior de um ser vivo.

Wednesday, August 15, 2012

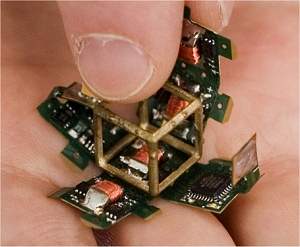

Microrrobôs "desbastam-se" para formar objetos

Auto-escultura robotizada

A ideia de construir módulos robotizados que consigam se unir para formar objetos

complexos não é nova, mas andava meio esquecida.

O conceito de robôs que constroem

robôs vai desde blocos automontantes até

a futurística argilotrônica,

eventualmente usandomicro ou nano robôs.

A ideia voltou à tona com o trabalhode

uma equipe do MIT, que está pensando em uma versão menos liquefeita da

argilotrônica: Kyle Gilpin e Daniela Rus chamam seu conceito de "areia

auto-escultora".

Areia inteligente"

Os grãos da "areia inteligente" são minúsculos

robôs que, em vez da abordagem mais tradicional, de irem se juntando para

formar um objeto maior, usam uma técnica subtrativa.

Da mesma forma que um escultor desbasta uma madeira ou uma

pedra, os robôs individuais vão saindo da sua "caixa de areia" até

deixar o objeto desejado perfeitamente modelado.

É um avanço substancial em relação à técnica aditiva desenvolvida pela mesma equipe, que

usava uma espécie de blocos de Lego robotizados que iam se unindo para formar

um robô maior.

Os cientistas afirmam ter testado com sucesso algoritmos que

operam a partir de uma areia inteligente real, ainda que bastante grossa - cada

"seixo inteligente" é um cubo com 1 centímetro de lado.

Os robôs individuais passammensagens para

a frente e para trás da estrutura, avisando quem deve permanecer do lugar e

quem deve ser "desbastado".

Ímãs eletropermanentes

Cada um dos grãos da areia inteligente possui

microprocessadores rudimentares, e um se une aos outros por ímãs especiais

instalados em quatro de suas seis faces.

São os chamados ímãs eletropermanentes, materiais que podem

ser magnetizados e desmagnetizados com um simples pulso elétrico, dispensando a

energia para manter a união entre os módulos.

É também através dos ímãs que os módulos se comunicam uns

com os outros.

Os protótipos possuem um microprocessador minúsculo, capaz

de armazenar um programa com 32 Kbytes, e contando com uma memória de 2 Kbytes.

É a equipe da Dra Rus que está por trás de um projeto

lançado recentemente pelo MIT, que pretende viabilizar a criação de robôs em

casa.

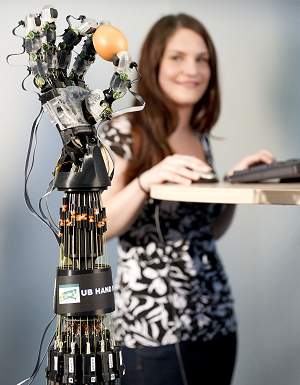

Mão robótica tem tendões artificiais similares aos humanos

Mão boba

Programar um robô para que ele pegue um jarro e coloque suco

em um copo pode ser uma tarefa extenuante.

Uma das maiores dificuldades é que pegar um jarro cheio

requer um nível de força e firmeza, enquanto pegar um copo de vidro vazio

requer suavidade e cuidado.

Engenheiros da Universidade de Saarland, na Alemanha,

acreditam que a saída é resolver a questão de uma vez por todas, passando aflexibilidade na

manipulação dos objetos para o hardware da mão robótica.

Assim, os programadores poderão

ficar livres para desenvolveraplicativos

mais criativos, dando funções mais práticas aos robôs.

A miniaturização dos motores elétricos permitiu que os

engenheiros simulassem a ação dos nervos da mão humana, usando-os para enrolar

e desenrolar fios que controlam os dedos de forma independente e precisa.

Usando esses tendões artificiais, o resultado é uma mão

robótica ao mesmo tempo forte e delicada, que dosa a força dependendo da tarefa

a desempenhar.

Imitando a mão humana

"Queríamos dar à nossa mão robótica um amplo espectro

de características humanas. Seus músculos artificiais devem ser capazes de

dispensar grandes forças com técnicas simples e compactas," disse Chris

May, coordenadora da equipe, que inclui pesquisadores de outras universidades

europeias.

Pequenos motores de alta velocidade liberam e recolhem fios

especiais de polímero, criando atuadores capazes de mover um objeto com até 5 quilogramas a 30 milímetros por

segundo, sem as tradicionais "tremidas" dos braços robóticos.

"Cada dedo robótico, como um dedo humano, é formado de

três segmentos, cada um controlado precisamente por tendões individuais,"

disse May. Cada tendão é formado por um fio de 20 centímetros .

A construção de mãos robóticas fortes, ágeis e

hábeis é um dos principais objetivos do projeto europeu Dexmart, que pretende

construir troncos robóticos com dois braços capazes de desempenhar tarefas

complexas.

Monday, August 13, 2012

Robô DJ usa Android para mudar sua experiência musical

Docking station robótica

DJs de todo o mundo, preocupai-vos.

Entrou no circuito Shimi, um robô-DJ desenvolvido pelo

Centro deTecnologia Musical,

ligado à Universidade da Geórgia, nos Estados Unidos.

O robô não apenas seleciona as músicas, como mantém o ritmo

baseando-se no feedback dado pelo público.

E, claro, ele próprio dança acompanhando a batida.

"O Shimi foi projetado para mudar a maneira pela qual

as pessoas curtem e pensam sobre sua música," disse Gil Weinberg,

idealizador do robô-DJ, que estreia hoje durante a Conferência Google I/O, em São Francisco.

Uma "banda" de três robôs Shimi fará uma apresentação

com músicas sintetizadas no laboratório, compostas mais acordo com os movimentos possíveis ao robô.

Robô com Android

O robô Shimi é essencialmente umadocking station, que tem

como "cérebro" um telefone celular com

sistema operacional Android.

O robô obtém a capacidade de ouvir e produzir música do

aparelho que for conectado a ele.

Em outras palavras, se existir no smartphone uma app para

qualquer coisa que explore suas capacidades, o Shimi está pronto para fazer o

resto.

Por exemplo, usando a câmera do celular e um software de

reconhecimento facial, o robô segue um ouvinte ao longo da sala, reposicionando

o aparelho para otimizar a audição.

Atendendo a pedidos

Mais interessante ainda é a capacidade de reconhecimento de

um ritmo: se o usuário bater palmas, ou fizer uma batucada no que quer que

seja, o robô varre a biblioteca musical do telefone e toca a música que melhor

combine com o ritmo sugerido.

Assim que a música começa a tocar, o robô dança seguindo o

ritmo.

Segundo o pesquisador, o Shimi 2.0, que já está em fase de

desenvolvimento, receberá apps que reconhecerão o balançar da cabeça

ou das mãos do usuário, sinalizando para que o robô aumente ou diminua o

volume, ou passe para a próxima música.

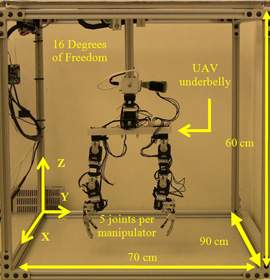

Robôs voadores

Avião com braços

Um robô voador com braços?

É exatamente isto o que o Dr. Paul Oh e seus colegas da

Universidade de Drexel, nos Estados Unidos, estão se propondo a construir.

Eles vão adicionar um conjunto de braços e mãos robóticos a

um veículo aéreo não tripulado (VANT), permitindo que este sobrevoe uma área e

desempenhe funções ao nível do solo.

Isto poderá incluir a deposição e recuperação de objetos, o

salvamento de pessoas, manutenções em redes elétricas e até trabalhos na

agricultura.

"Eles poderão ajudar no reparo de obras de

infraestrutura. Em vez de içar um trabalhador sobre uma ponte ou uma torre,

esses robôs poderão ser equipados para sobrevoar a obra e fazer tarefas como

soldagem, por exemplo," diz o Dr. Oh.

"Esse tipo de aeronave vai colocar os robôs de serviço

em um novo patamar, permitindo que eles façam coisas como busca e salvamento e atendimento em

áreas de desastres," completa ele.

Problemas de estabilidade

O grande desafio do projeto, que está sendo financiado pela

Fundação Nacional de Ciências (NSF) é garantir que o robô voador interaja com

os objetos sem perder a estabilidade.

Para entender melhor as forças e os torques associados com o movimento dos braços

robóticos em uma máquina voadora, os pesquisadores estão estudando a melhor

forma de fixação dos braços em uma estrutura intermediária, e desta estrutura

na aeronave.

Os testes estão sendo feitos inicialmente no laboratório, em

uma plataforma móvel capaz de imitar os movimentos laterais e longitudinais do

VANT.

Só depois de tudo bem simulado e avaliado é que os braços

robóticos serão montados em um robô voador real.

"São questões de projeto extremamente desafiadoras, que

ninguém abordou antes," diz o pesquisador.

A ideia é que os braços robóticos e sua armação de

sustentação sejam testados em helicópteros, quadricópteros e balões dirigíveis.

Thursday, August 9, 2012

Atmobot - The Purify Air Robot

Wednesday, August 8, 2012

Robô que lava Cabelos - Panasonic

Robô que lava cabelos

A principal tecnologia do robô que lava cabelos é

um sistema de mãos

robóticas, nesta versão com 24 dedos no total, para simular melhor o

movimento mais flexível das mãos humanas.

Pode parecer uma tarefa fácil fazer uma mão robótica lavar

uma cabeça. Certamente não é tão difícil projetar um sistema para lavar uma

bola, mas cabeças humanas têm formatos muito diferentes, e costumam se mover

repentinamente.

Os engenheiros então melhoraram o escaneamento da cabeça,

feito em tempo real, e incorporaram novas técnicas de esfregação e massagem,

atendendo a sugestões dos profissionais que testaram o robô.

Assim como os ciclos de uma lavadora de roupas, o robô

lavador de cabelos possui funções de lavação, massagem, aplicação de

condicionador, enxague e secagem.

Ele tem ainda memória para guardar as preferências e o

formato da cabeça dos usuários, para atender mais prontamente os clientes que

retornarem.

Robôs para Hospitais

Robôs para hospitais

A empresa japonesa

Panasonic apresentou novas versões de seus robôs para hospitais e cuidados com a saúde, além de

melhoramentos do seu robô lavador de cabelos.

Protótipos da cama robótica e do robô que lava cabelos haviam sido

apresentados durante uma feira de reabilitação realizada em Tóquio no ano

passado.

A empresa afirma ter recebido várias sugestões de

melhoramentos, que resultaram nos equipamentos que estão sendo mostrados na

feira deste ano.

Mas a empresa tem também novidades, como um robô de teleconferências

projetado especificamente para hospitais.

Robô de comunicação

Como seu nome indica bem, o Hospi foi desenvolvido visando a

comunicação no interior de um hospital. A empresa o chama de "Mobilidade e

Inteligência Remotas".

O robô é dotado de uma tecnologiade

mobilidade autônoma e de um sistema de intercomunicação com vídeo de alta

definição.

A mobilidade do robô é híbrida, podendo ser feita por

controle remoto ou pela inteligência do robô. Mas, mesmo quando ele está sendo

controlado remotamente, ele continua a coletar os dados do ambiente de forma a

se localizar emnovas empreitadas futuras.

Sua função mais importante é a conversação entre pacientes,

médicos e visitantes do hospital, tudo feito por vídeo de alta definição.

Cama robótica

A RoboticBed® nasceu como uma cama elétrica, mas agora já

incorpora funções avançadas para auxiliar uma pessoa a passar da cama para uma

cadeira de rodas,

e dela de volta para a cama, sem auxílio.

Todo o sistema foi padronizado, e agora o que há é uma

transformação de uma cama em uma cadeira de rodas e vice-versa, criando um robô

verdadeiro, capaz de

movimentar o paciente com mais suavidade.

No modo cadeira de rodas, os mesmos mecanismos de ajuste de

uma cama de hospital são aplicados para distribuir adequadamente o peso do

corpo e evitar dores por uma posição constante por muito tempo.

A cadeira também agora pode se transformar em uma cama, um

pouco mais estreita, em qualquer local onde ela estiver.

O sistema de controle também foi simplificado e colocado no

braço da cadeira.

Tuesday, August 7, 2012

Monday, August 6, 2012

Thursday, August 2, 2012

Leonardo Robot

Overview

This

project is a collaboration with the world famous Stan Winston Studio. It

combines the studio's artistry and expertise in creating compelling animatronic

characters with state of the art research in socially intelligent robots. We

have christened this new character collaboration with a name that embodies art,

science and invention. Hence, the name "Leonardo" -- namesake of

Leonardo DaVinci, the Renaissance scientist, inventor and artist.

Indeed, Leonardo is the Stradivarius of expressive robots.

Indeed, Leonardo is the Stradivarius of expressive robots.

Robot

Mechanics

Leonardo has 69 degrees of freedom --- 32 of those are in the face alone. As a result, Leonardo is capable of near-human facial expression (constrained by its creature-like appearance). Although highly articulated, Leonardo is not designed to walk. Instead, its degrees of freedom were selected for their expressive and communicative functions. It can gesture and is able to manipulate objects in simple ways. Standing at about2.5 feet tall, it is the

most complex robot the studio has attempted (as of Fall 2001). Leonardo is the

most expressive robot in the world today.

Leonardo has 69 degrees of freedom --- 32 of those are in the face alone. As a result, Leonardo is capable of near-human facial expression (constrained by its creature-like appearance). Although highly articulated, Leonardo is not designed to walk. Instead, its degrees of freedom were selected for their expressive and communicative functions. It can gesture and is able to manipulate objects in simple ways. Standing at about

Robot Aesthetics

Unlike the vast majority of autonomous robots today, Leonardo has an organic appearance. It is a fanciful creature, clearly not trying to mimic any living creature today. This follows from our philosophy that robots are not and will never be dogs, cats, humans, etc. so there is no need to make them look as such. Rather, robots will be their own kind of creature and should be accepted, measured, and valued on those terms. We gave Leonardo a youthful appearance to encourage people to playfully interact with it much as one might with a young child.

Unlike the vast majority of autonomous robots today, Leonardo has an organic appearance. It is a fanciful creature, clearly not trying to mimic any living creature today. This follows from our philosophy that robots are not and will never be dogs, cats, humans, etc. so there is no need to make them look as such. Rather, robots will be their own kind of creature and should be accepted, measured, and valued on those terms. We gave Leonardo a youthful appearance to encourage people to playfully interact with it much as one might with a young child.

Embedded

Multi-Axis Motion Controller

Exploring human-robot interaction requires constructing increasingly versatile and sophisticated robots. Commercial motor-driver and motion-controller packages are designed with a completely different application in mind (specifically industrial robots with relatively small numbers of relatively powerful motors) and do not adapt well to complex interactive robots with a very large number of small motors controlling things like facial features. Leonardo, for instance, includes sixty-some motors in an extremely small volume. An enormous rack of industrial motion controllers would not be a practical means of controlling the robot; an embedded solution designed for this sort of application is required.

We have developed a motor control system to address the specific needs of many-axis interactive robots. It is based on a modular colletion of motor control hardware which is capable of driving a very large number of motors in a very small volume. Both 8-axis and 16-axis control packages have been developed.

These controllers support simultaneous absolute position and velocity feedback, allowing good dynamic performance without the need for lenghty calibration phase at power-up. Example firmware has been developed which supports accurate position estimation and PD control to a continuously-updated target position. The control system is highly flexible, allowing alternative control algorithms to be developed with ease.

A generic software library has also been developed to provide a clean interface betwen high-level control code and low-level motor hardware, as has a generic network protocol, known as the Intral-Robot Communications Protocol, which provides a simple and extensible framework for inter-module communication within a complex robot control system.

For instance, 4 of the 16-axis motor controller packages are used to control Leonardo. A single 8-axis package is used to control RoCo.

The motor drivers are standard FET H-bridges; recent advances in FET process technology permit surprisingly low RDS on losses, and switching at relatively low (1-10kHz) frequencies reduces switching losses. Hence, the power silicon (and thus the package as a whole) can be reduced in size. The audible hum and interference due to the low switching frequency (which is completely unacceptable for an organic looking robot) is eliminated by using a variable-mean spread-spectrum control signal, rather than traditional PWM. The sixteen channels each support current feedback, encoder feedback, and analog feedback, and the system is controlled by a custom SoC motion controller with an embedded soft processor core implemented in a Xilinx Virtex FPGA.

Exploring human-robot interaction requires constructing increasingly versatile and sophisticated robots. Commercial motor-driver and motion-controller packages are designed with a completely different application in mind (specifically industrial robots with relatively small numbers of relatively powerful motors) and do not adapt well to complex interactive robots with a very large number of small motors controlling things like facial features. Leonardo, for instance, includes sixty-some motors in an extremely small volume. An enormous rack of industrial motion controllers would not be a practical means of controlling the robot; an embedded solution designed for this sort of application is required.

We have developed a motor control system to address the specific needs of many-axis interactive robots. It is based on a modular colletion of motor control hardware which is capable of driving a very large number of motors in a very small volume. Both 8-axis and 16-axis control packages have been developed.

These controllers support simultaneous absolute position and velocity feedback, allowing good dynamic performance without the need for lenghty calibration phase at power-up. Example firmware has been developed which supports accurate position estimation and PD control to a continuously-updated target position. The control system is highly flexible, allowing alternative control algorithms to be developed with ease.

A generic software library has also been developed to provide a clean interface betwen high-level control code and low-level motor hardware, as has a generic network protocol, known as the Intral-Robot Communications Protocol, which provides a simple and extensible framework for inter-module communication within a complex robot control system.

For instance, 4 of the 16-axis motor controller packages are used to control Leonardo. A single 8-axis package is used to control RoCo.

The motor drivers are standard FET H-bridges; recent advances in FET process technology permit surprisingly low RDS on losses, and switching at relatively low (1-10kHz) frequencies reduces switching losses. Hence, the power silicon (and thus the package as a whole) can be reduced in size. The audible hum and interference due to the low switching frequency (which is completely unacceptable for an organic looking robot) is eliminated by using a variable-mean spread-spectrum control signal, rather than traditional PWM. The sixteen channels each support current feedback, encoder feedback, and analog feedback, and the system is controlled by a custom SoC motion controller with an embedded soft processor core implemented in a Xilinx Virtex FPGA.

Wednesday, August 1, 2012

Tuesday, July 31, 2012

Monday, July 30, 2012

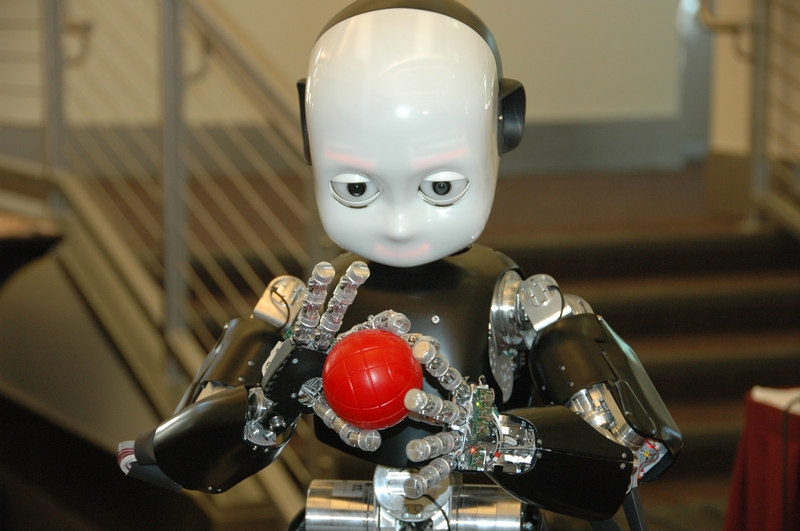

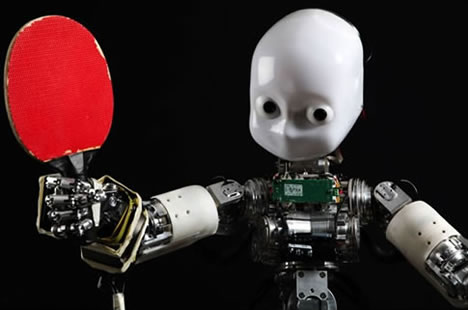

The iCub - The Robot Child

The iCub is

the humanoid robot developed at IIT as part of the EU project

RobotCub and subsequently adopted by more than 20 laboratories worldwide. It

has 53 motors that move the head, arms & hands, waist, and legs. It can see

and hear, it has the sense of proprioception (body

configuration) and movement (using accelerometers and gyroscopes). We are

working to improve on this in order to give the iCub the sense of touch and to

grade how much force it exerts on the environment.

New life is being injected into the iCub platform through

the development of force control. This new skill enables safe and gentle

interaction of the robot with human teachers.

iCub grasping skills have been recently improved as a result

of the Poeticon EU project. Simple actions such as grasping are combined

through the use of spoken language tools developed by the Poeticon teams. In

this example, the iCub pours cereals in a cup.

New visual skills of the iCub. Independent motion tracking

for the iCub using optical flow. See how we can easily track objects or people

that move independently of the iCub.

The iCub met the Italian President in 2010 during a visit to

Genoa and IIT. Here the President is asking about the robot after receiving the

latest IIT leaflet from the hand of the iCub.

The iCub was in Hannover in April 2010 as part of the

Italian delegation to the international fair and exhibit. Here's interacting

with the German Chancellor Angela Merkel while showing its movement

coordination skills and software reliability. The iCub ran uninterrupted for

three full days attracting thousands of curious visitors.

The iCub can be obtained from the Italian Institute of

Technology for a fee (indicative prices are shown). We do not make a

profit from this activity but nonetheless we strive to provide the best

possible quality and first class support to all iCub owners. We need you for

doing this even better!

For more information or for a formal quotation please

contact Giorgio Metta at: info@icub.org

Friday, July 20, 2012

Windoro WCR-I001 Window Cleaning Robot Single Panes

• First window

cleaning robot

• Cleans your windows systematically using microfiber cleaning cloths

• Clean, safe and simple

• Cleans up to 2 hours on a single charge

• Cleans windows with thickness of 5-15mm

The Windoro WCR-I001 Window Cleaning Robot is the first window cleaning robot in the world. Innovative and practical, it cleans your windows entirely with its microfiber pads and cleaning solution. Equipped with 2 magnetic modules it navigates your windows safely and can cover up to15 square meters

on a single charge.

Windoro operates in tandem with two modules which hold together magnetically. Once the modules are positioned on either side of your window, an automatic cleaning can begin. The inside module works as the navigation unit and the outside module cleans using spinning microfiber pads. Once the cleaning is started, it moves in a zigzag pattern while spraying cleaning solution and activating its microfiber pads. It returns to it's starting point when the cleanup is finished.

• Cleans your windows systematically using microfiber cleaning cloths

• Clean, safe and simple

• Cleans up to 2 hours on a single charge

• Cleans windows with thickness of 5-15mm

The Windoro WCR-I001 Window Cleaning Robot is the first window cleaning robot in the world. Innovative and practical, it cleans your windows entirely with its microfiber pads and cleaning solution. Equipped with 2 magnetic modules it navigates your windows safely and can cover up to

Windoro operates in tandem with two modules which hold together magnetically. Once the modules are positioned on either side of your window, an automatic cleaning can begin. The inside module works as the navigation unit and the outside module cleans using spinning microfiber pads. Once the cleaning is started, it moves in a zigzag pattern while spraying cleaning solution and activating its microfiber pads. It returns to it's starting point when the cleanup is finished.

Windoro is especially useful on large windows, bay

windows, and sunrooms. It adapts to all types of windows that are equipped with

double panes with thickness ranging from 5 to 15mm. It's edge cleaning strips

located on each side allow cleaning to the edges of the glass.

Windoro features:

SMART One Button Cleaning

Open the window that is needed for cleaning and attach WINDORO on both sides of window. Once WINDORO is attached, press the start button on top of the robot. WINDORO will then automatically start a cleaning cycle.

SMART End Signal and Automatic Return

The user will be alarmed by a beep from the machine, WINDORO will then return to its initial start point.

SMART Magnetic Force Controller

The magnetic force is controlled by the magnetic sensor, and it cleans windows with a wide range of thickness varying from 5~15mm.

SAFE Excellent Safety

The robot will remain tightly attached to the window whether or not the power has been turned off. It consists of two modules that fit on opposite sides of the window and hold each other using permanent magnets.

CLEAN Perfect Cleaning

The combination of a precise amount of detergent spray and the spinning microfiber pads clean the window perfectly.

EASY Convenient Detachable Pad

The microfiber pad with Velcro tape can be conveniently detached and re-applied after washing. (For perfect cleaning of a dirty window, clean the window repeatedly after changing pads.)

SMART One Button Cleaning

Open the window that is needed for cleaning and attach WINDORO on both sides of window. Once WINDORO is attached, press the start button on top of the robot. WINDORO will then automatically start a cleaning cycle.

SMART End Signal and Automatic Return

The user will be alarmed by a beep from the machine, WINDORO will then return to its initial start point.

SMART Magnetic Force Controller

The magnetic force is controlled by the magnetic sensor, and it cleans windows with a wide range of thickness varying from 5~15mm.

SAFE Excellent Safety

The robot will remain tightly attached to the window whether or not the power has been turned off. It consists of two modules that fit on opposite sides of the window and hold each other using permanent magnets.

CLEAN Perfect Cleaning

The combination of a precise amount of detergent spray and the spinning microfiber pads clean the window perfectly.

EASY Convenient Detachable Pad

The microfiber pad with Velcro tape can be conveniently detached and re-applied after washing. (For perfect cleaning of a dirty window, clean the window repeatedly after changing pads.)

Subscribe to:

Comments (Atom)